Файл: Тема Подходы к понятию информации и измерению информации. Информационные объекты различных видов. Цель.doc

ВУЗ: Не указан

Категория: Не указан

Дисциплина: Не указана

Добавлен: 07.11.2023

Просмотров: 32

Скачиваний: 2

ВНИМАНИЕ! Если данный файл нарушает Ваши авторские права, то обязательно сообщите нам.

Тема: Подходы к понятию информации и измерению информации. Информационные объекты различных видов.

Цель: дать представление о различиях подходах к понятию информации, рассмотреть информационные объекты различных видов.

Задачи:

-

Образовательные: дать понятие количества информации, познакомить с вероятностным и алфавитным подходом при определении количества информации, познакомить с единицами измерения информации, формировать практические навыки по определению количества информации. -

Развивающие: продолжить формирование научного мировоззрения, расширять словарный запас по теме «Информация» -

Воспитательные: формировать интерес к предмету, воспитывать настойчивость в преодолении трудностей в учебной работе.

Вопросы:

-

Информация.Информационные объекты различных видов. -

Подходы к понятию информации и измерению информации.

Теоретический материал.

1. Информация. Информационные объекты различных видов

Информатика - это наука об организации процессов получения, хранения, обработки и передачи информации в системах различной природы. Информатика также изучает возможность автоматизации информационных процессов компьютерными средствами. Синонимом слова "компьютер" является "электронно-вычислительная машина" или ЭВМ. Персональный компьютер - один из видов компьютеров наряду с многопроцессорными и мультисистемными компьютерами. Сущность же компьютера - это транзисторная технология, которая реализована во всей современной радиотехнике. Более того, процессор как основа компьютера также не является уникальным явлением, так как процессоры сегодня могут иметь как телефоны, телевизоры, так и другие бытовые устройства.

Информация (в переводе с латинского informatio - разъяснение, изложение) - это ключевое понятие современной науки, которое стоит в одном ряду с такими как "вещество" и "энергия". Существует три основные интерпретации понятия "информация".

Научная интерпретация. Информация - исходная общенаучная категория, отражающая структуру материи и способы ее познания, несводимая к другим, более простым понятиям.

Абстрактная интерпретация. Информация - некоторая последовательность символов, которые несут как вместе, так в отдельности некоторую смысловую нагрузку для исполнителя.

Конкретная интерпретация. В данной плоскости рассматриваются конкретные исполнители с учетом специфики их систем команд и семантики языка. Так, например, для машины информация - нули и единицы; для человека - звуки, образы, и т.п.

Существуют несколько концепций (теорий) информации.

Первая концепция (концепция К. Шеннона), отражая количественно-информационный подход, определяет информацию как меру неопределенности (энтропию) события. Количество информации в том или ином случае зависит от вероятности его получения: чем более вероятным является сообщение, тем меньше информации содержится в нем.

Вторая концепция рассматривает информацию как свойство (атрибут) материи. Ее появление связано с развитием кибернетики и основано на утверждении, что информацию содержат любые сообщения, воспринимаемые человеком или приборами. Наиболее ярко и образно эта концепция информации выражена академиком В.М. Глушковым.

Третья концепция основана на логико-семантическом (семантика - изучение текста с точки зрения смысла) подходе, при котором информация трактуется как знание, причем не любое знание, а та его часть, которая используется для ориентировки, для активного действия, для управления и самоуправления. Иными словами, информация - это действующая, полезная, "работающая" часть знаний. Представитель этой концепции В.Г. Афанасьев.

В настоящее время термин информация имеет глубокий и многогранный смысл. Во многом, оставаясь интуитивным, он получает разные смысловые наполнения в разных отраслях человеческой деятельности:

-

в житейском аспекте под информацией понимают сведения об окружающем мире и протекающих в нем процессах, воспринимаемые человеком или специальными устройствами; -

в технике под информацией понимают сообщения, передаваемые в форме знаков или сигналов; -

в теории информации (по К.Шеннону) важны не любые сведения, а лишь те, которые снимают полностью или уменьшают существующую неопределенность; -

в кибернетике, по определению Н. Винера, информация - эта та часть знаний, которая используется для ориентирования, активного действия, управления, т.е. в целях сохранения, совершенствования, развития системы; -

в семантической теории (смысл сообщения) - это сведения, обладающие новизной, и так далее...

Такое разнообразие подходов не случайность, а следствие того, что выявилась необходимость осознанной организации процессов движения и обработки того, что имеет общее название - информация.

-

Подходы к понятию информации и измерению информации.

Содержательный подход к измерению информации. Сообщение – информативный поток, который в процессе передачи информации поступает к приемнику. Сообщение несет информацию для человека, если содержащиеся в нем сведения являются для него новыми и понятными Информация - знания человека? сообщение должно быть информативно. Если сообщение не информативно, то количество информации с точки зрения человека = 0. (Пример: вузовский учебник по высшей математике содержит знания, но они не доступны 1-класснику)

Алфавитный подход к измерению информации не связывает кол-во информации с содержанием сообщения. Алфавитный подход - объективный подход к измерению информации. Он удобен при использовании технических средств работы с информацией, т.к. не зависит от содержания сообщения. Кол-во информации зависит от объема текста и мощности алфавита. Ограничений на max мощность алфавита нет, но есть достаточный алфавит мощностью 256 символов. Этот алфавит используется для представления текстов в компьютере. Поскольку 256=28, то 1символ несет в тексте 8 бит информации.

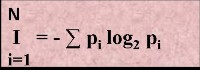

Вероятностный подход к измерения информации. Все события происходят с различной вероятностью, но зависимость между вероятностью событий и количеством информации, полученной при совершении того или иного события можно выразить формулой которую в 1948 году предложил Шеннон.

I - количество информации

N – количество возможных событий

pi – вероятности отдельных событий

Количество информации - это мера уменьшения неопределенности.

1 БИТ – такое кол-во информации, которое содержит сообщение, уменьшающее неопределенность знаний в два раза.

БИТ- это наименьшая единица измерения информации

Единицы измерения информации: 1байт = 8 бит

1Кб (килобайт) = 210 байт = 1024 байт

1Мб (мегабайт) = 210 Кб = 1024 Кб

1Гб (гигабайт) = 210 Мб = 1024 Мб

Задача 1: Какое количество информации будет содержать зрительное сообщение о цвете вынутого шарика, если в непрозрачном мешочке находится 50 белых, 25 красных, 25 синих шариков. Для этого необходимо использовать следующую формулу

Вероятность события выражается в долях единицы и вычисляется по формуле:

1) всего шаров 50+25+25=100

2) вероятности шаров 50/100=1/2, 25/100=1/4, 25/100=1/4

3) I= -(1/2*log21/2 + ¼*log21/4 + ¼*log21/4) = -(1/2*(0-1) +1/4*(0-2) +1/4*(0-2)) = 1,5 бит

Количество информации достигает max значения, если события равновероятны, поэтому количество информации можно рассчитать по формуле

Задача 2 В корзине лежит 16 шаров разного цвета. Сколько информации несет сообщение, что достали белый шар?

т.к. N = 16 шаров, то I = log2 N = log2 16 = 4 бит.

Упражнение (устно)

1) Какое количество информации будет получено при отгадывании числа из интервала:

- от 1 до 64 - от 1 до 61 - от 1 до 20.

2) Какое количество информации будет получено после первого хода в игре «крестики-нолики» на поле:

- 3x3 - 4x4.

3) Сколько могло произойти событий, если при реализации одного из них получилось 6 бит информации.

Задачи для самостоятельного решения

-

В розыгрыше лотереи участвуют 64 шара. Выпал первый шар. Сколько информации содержит зрительное сообщение об этом? -

В игре «лото» используется 50 чисел. Какое количество информации несет выпавшее число? -

Какое количество информации несет сообщение о том, что встреча назначена на 3 июля в 18.00 часов? -

Вы угадываете знак зодиака вашего друга. Сколько вопросов вам нужно при этом задать? Какое количество информации вы получите? -

В ящике лежат фигурки разной формы - треугольные и круглые. Треугольных фигурок в ящике 15. Сообщение о том, что из ящика достали фигуру круглой формы, несет 2 бита информации. Сколько всего фигурок было в ящике? -

В ведерке у рыбака караси и щуки. Щук в ведерке 3. Зрительное сообщение о том, что из ведра достали карася, несет 1 бит информации. Сколько всего рыб поймал рыбак? -

Частотный словарь русского языка - словарь вероятностей (частот) появления букв в произвольном тексте — приведен ниже. Определите, какое количество информации несет каждая буква этого словаря.

| Символ | Частота | Символ | Частота | Символ | Частота | Символ | Частота |

| о | 0.090 | в | 0.035 | я | 0.018 | ж | 0.007 |

| е, ё | 0.072 | к | 0.028 | Ы, 3 | 0.016 | ю, ш | 0.006 |

| а, и | 0.062 | м | 0.026 | ь, ъ, б | 0.014 | ц, щ, э | 0.003 |

| т, н | 0.053 | д | 0.025 | ч | 0.013 | Ф | 0.002 |

| с | 0.045 | п | 0.023 | и | 0.012 | | |

| Р | 0.040 | У | 0.021 | X | 0.009 | | |

Используя результат решения предыдущей задачи, определите количество информации в слове «КОМПЬЮТЕР».

Литература:

Информатика и ИКТ, 10 класс, Базовый уровень, Макарова Н.В., 2009

Информатика. Макарова Н.В., В.Б. Волков, Питер 2011

Информатика и ИКТ. 10 класс. Профильный уровень. Угринович Н.Д. 3-е изд., испр. - М.: 2008.

Энциклопедия знаний - http://www.pandia.ru/text/77/203/78371.php

Школьный интернет-учебник М.А. и М.В. Выграненко - http://iiikt.narod.ru/osnov/2_1_lang.htm