ВУЗ: Не указан

Категория: Не указан

Дисциплина: Не указана

Добавлен: 25.10.2023

Просмотров: 30

Скачиваний: 1

ВНИМАНИЕ! Если данный файл нарушает Ваши авторские права, то обязательно сообщите нам.

Лекции ИИ

Этапы изучения:

1) Основные понятия

2) Классическая логика => нечеткая логика

3) Программно-аппаратное средство ИИ – совокупность инструкций и команд в совокупности с инструментами

Языки: Python, Prolog (семантика), Eclipse

4) Математическое моделирование систем ИИ

(( Для автомата: посещение, тесты, рефераты, самостоятельные работы, посещенные и решенные задачи по практике ))

ИИ – направление науки и техники, ориентированное на создание программно-аппаратных средств решения интеллектуальных задач.

Интеллектуальная задача – задача, в которой логическая (смысловая) обработка информации превалирует над вычислительной.

Программы систем ИИ: Динамо Прайм (была), сейчас Динамо Сандбокс

Составляющие программ ИИ:

-

Технология принятия решения -

Система управления роботами -

Умный дом -

Системы распознавания -

Системы определения

Знание – информация по свойствам объектов, полученная на протяжении всей жизни

Данные – то, что на данный момент можем задать машине

ИИ появился 1945 г. (Тьюринг)

Нейронка

Левое полушарие:

- отвечает за логико-символическую обработку

- модели символьно-логического уровня

- логическая информация

- эвристическая информация

Правое полушарие:

- обработка образной информации

- модели образного уровня

- нейросети

- генетические алгоритмы

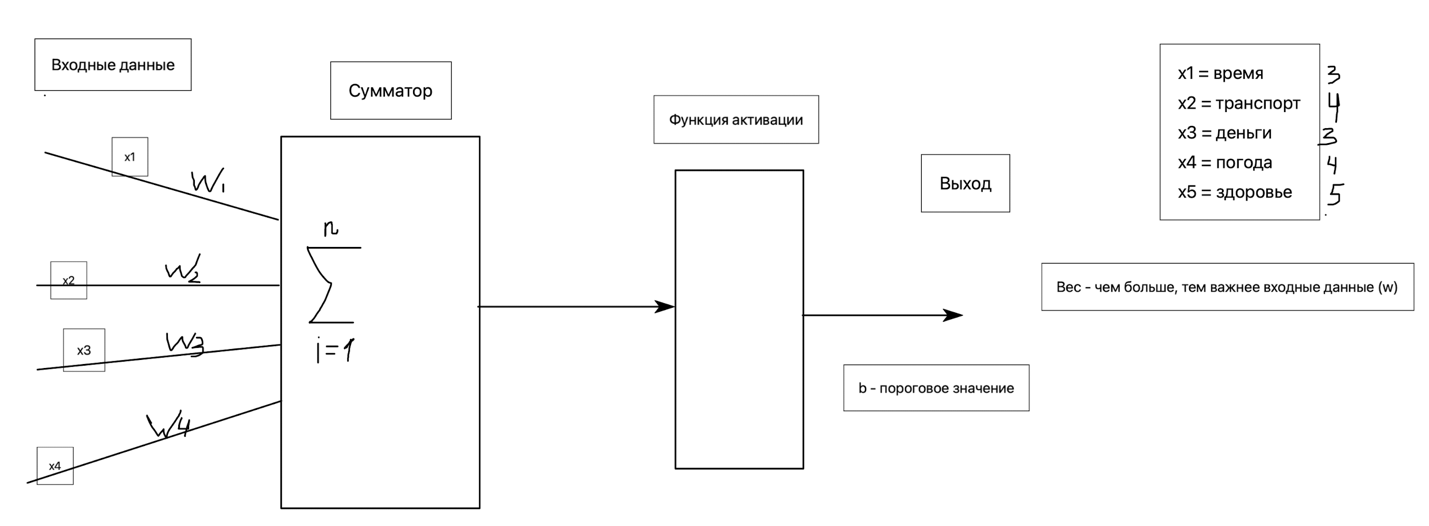

Нейронные сети - распространение электрического сигнала

Функции активации:

-

Функция единичного скачка -

Функция активации – это функция сигмоиды (?) -

Гиперболический анализ (тангенс, котангенс)

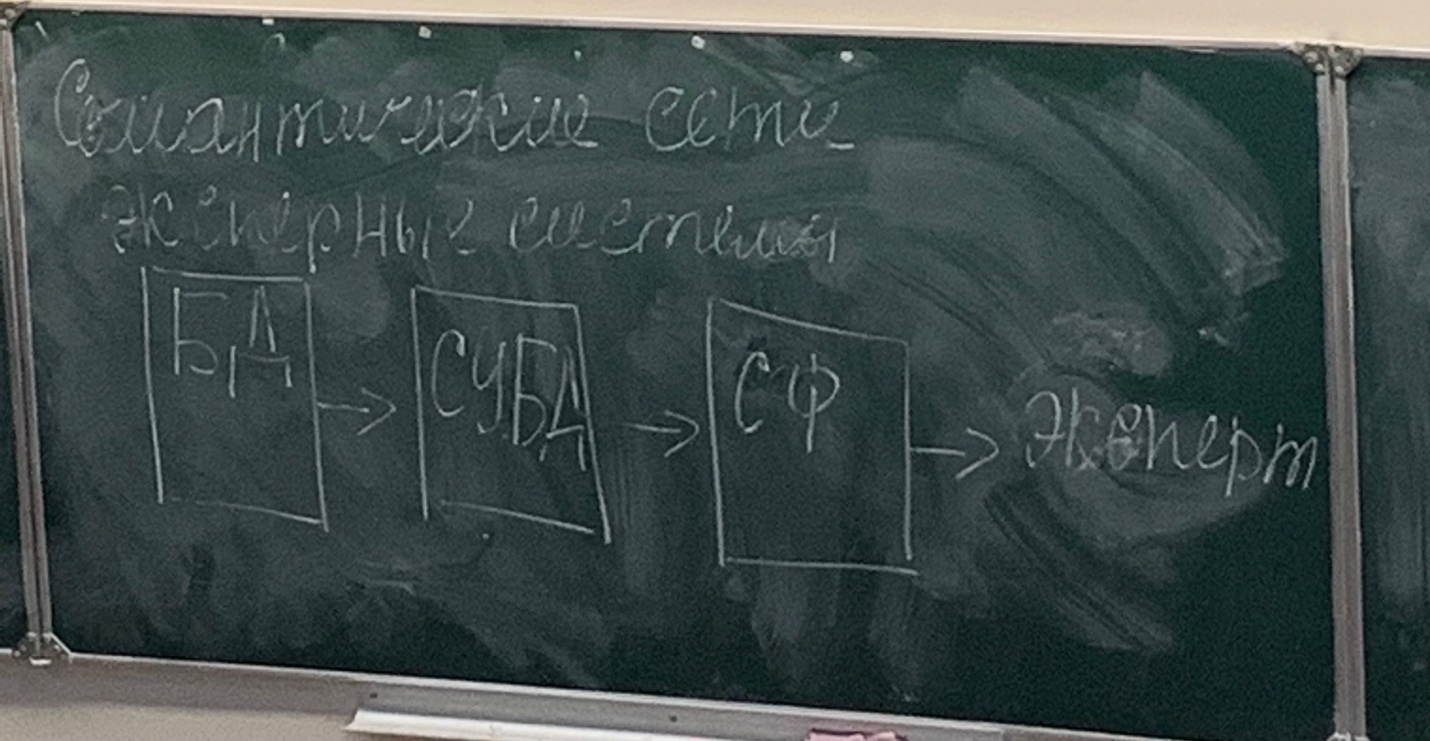

Семантические сети

Экспертные системы

Экспертные системыСФ – система фильтров

Кибернетика

Нейрокибернетика

ЛЕКЦИЯ 3 (2 потерялься)

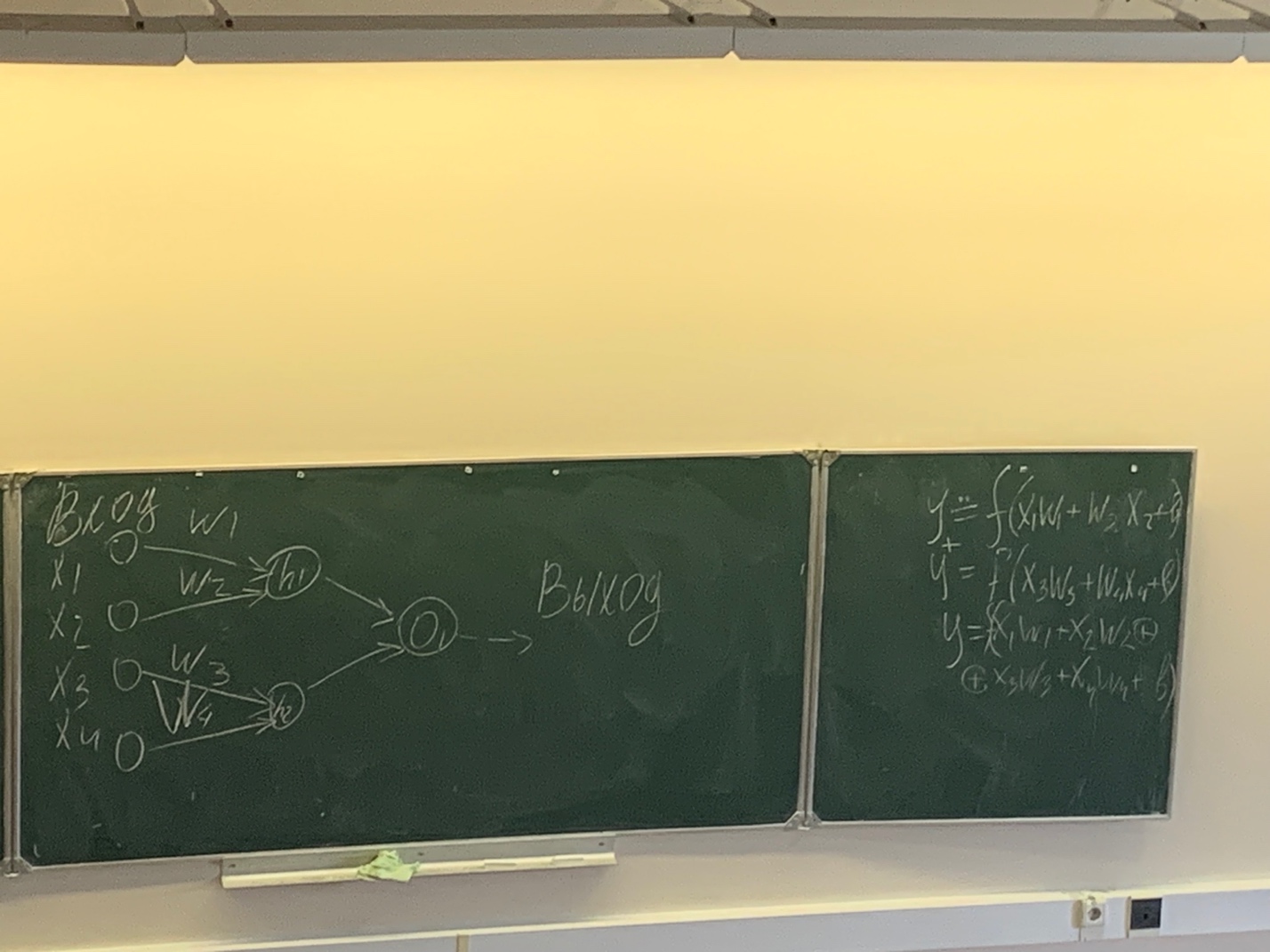

Искусственные нейронные сети

miniconda 3.10

IDE Spyder

Устанока: conda install spyder (для windows через power shell)

Необходимые библиотеки:

-

numpy -

matplotlib

Технологии:

- jupyter

- colab google

Искусственная нейронная сеть - программа, реализующая имитацию распространение электрического сигнала

Искусственный нейрон – составная часть любой нейросети

2 вида нейронов:

-

однослойный персептрон

- линейный

- адаптивный

-

многослойный персептрон

Обучение нейронки:

Обучение нейронки:Розенблатт: A – R обучение, S={-1, 0, 1}, w = 1, ba = 1

Ромельхарт: S->A и A->S обучение

Бернард, Уидроу – берется не просто сумма произведения, а средняя квадратичная ошибка. После S-элементов следует чистый выход -> далее ф-я активаации

Алгоритм распространения ошибки:

-

прямой -

обратный (называют обратным бустером)

Многослойный персептрон

Многослойная нейронная сеть – та, у которой больше 1 скрытого слоя

ИНС построенная на 2-х искусственных нейронов

В элементарном искусственном нейроне входные элементы и веса могут принимать любые значения

В персептроне на вход могут подаваться 0 или 1, пороговое значение А-элементов равно 1, весовые значения равны 1

Сигмоидальная ф-я активации растет с 0 до 1 при каждом изменении значения х. Сигмоидальная ф-я является гладкой непрерывной. Это значит, что ф-я имеет производную

При изменении весового коэф-та изменяется уровень наклона графика сигмоидальной ф-и

При изменении весового коэф-та изменяется уровень наклона графика сигмоидальной ф-иФормирование датасета для обучающей выборки

Датасет – коллекция значений для обучающей НС

Стадии обучения:

-

обучающая выборка -

Фитнес (тренировка) -

оценка качества

05.04

Классификация нейронных сетей

-

По структуре (По типу связей между нейронами):

– неполносвязные

– полносвязные

– с нерегулярными связями

– с регулярными связями

– с симметричными связями

– с симметричными связями– с несимметричными связями

-

Особенности модели нейронов -

Особенности получения сети

Неполносвязные нейронные сети обычно описывают неполносвязными ориентированными графами. Разделяют на однослойные и многослойные (по Розенблатту: все, что имеет больше 1 скрытогоо слоя – многослойный;

Многослойные нейронные сети подразделяются на сети с прямыми, перекрестными и обратными связями

В нейронных сетях с прямыми связями нейро какого-либо слоя могут связываться только с нейронами предыдущих слоев

В нейронных сетях с перекрестными связями ограничения на связи нет, допускаются связи внутри одного слоя

Разделение по входному сигналу: аналоговые и цифровые

Разделение по времени: с непрерывным и дискретным временем (в основном используют дискретное время)

Также разделяют:

- Подача сигнала на синопс нейрона

- Подача сигнала на выходны нейронов

- Подача сигналов в виде весов

- Адаптивная подача на синопсы входных нейронов

По съему(?)

Съем с выходов выходных нейронов

Съем с синапсов

Съем в виде значений весов синапсов выходных нейронов

По способу обучения:

- обучение с учителем (обучающий подает примеры на этапе обучения и оценивает правильность функционирования нейронной сети)

- обучение без учителя

Под состоянием нейронной сети обычно понимают:

- веса синапсов нейронов (меняется крутизна функции-сигмоиды)

- веса синапсов и пороги нейронов (меняется смещение функции вдоль оси)

Разделяют нейроны:

-

по способу обучения:

- способ обучения по входам

- способ обучения по выходам

Применение нейронных сетей

В качестве образов могут выступать объекты – символы, тексты, образцы изображений, звуков.

При обучении сети предлагаются различные образцы

Образец – значение признака, при этом совокупность всех признаков должна однозначно определять класс, к которому относится образец. В случае, если признаков недостаточно, то нейросеть может соотнести образцы с образцами других классов. По окончанию обучения ей можно предоставлять ранее обработанные образцы и получить ответ принадлежности к определенному классу. Количество классов соответствует количеству слоев, определяемых классы

Принятие решения и управление

Кластеризация – разбиение множества входных сигналов на классы при том, что количество входных сигналов заранее неизвестно. После обучения нейросеть способна понимать, к какому классу относится сигнал, либо не относится к классам, что означает появление нового класса

Доказана обобщенная аппроксимационная теорема. Сжатие данных и ассоциативная память – способность нейросетей к появлению взаимосвязей между различными параметрами позволяет выразить данные большой размерности,

если данные связаны друг с другом

Обратный процесс называется ((сирректиной??)) памятью.

19.04

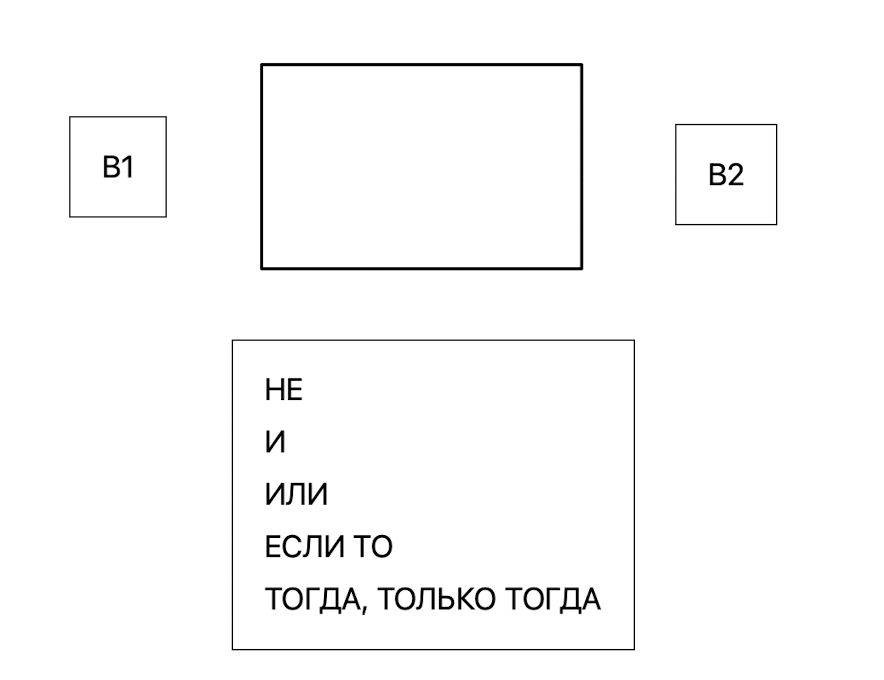

Алгебра высказываний

Высказывание - это утверждение, про которое можно сказать, истинно оно или ложно

Сложные высказывания называются математическими предложениями

Алгебра высказываний:

-

Математическое предложение -

Высказывание

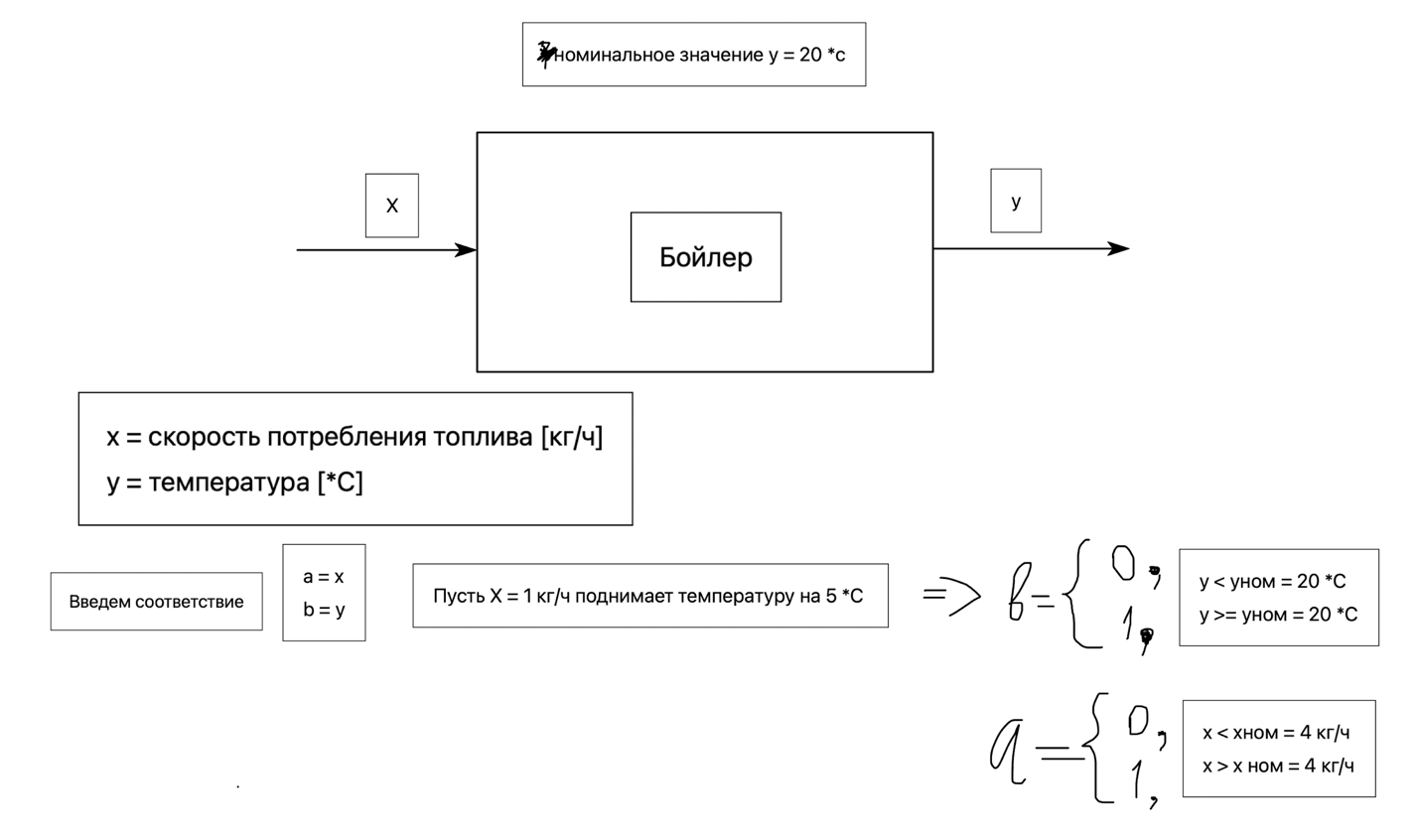

Понятие нечеткой логики и нечеткой системы

Системы искусственного интеллекта основано на использовании математического аппарата нечеткой логики, является наиболее простым. Данную систему принято называть нечеткими. Обычно такие системы используются для автоматических, командных или управленческих воздействий над управляемыми объектами, не относящихся к аппаратам или объектам ответственного назначения (электростанции…)

Характерной особенностью нечетких систем является использование правил логического вывода, заложенных в них человеком. Данные правила относятся к простейшим продукционным правилам, используемых к экспертных системах.

Продукционная модель описывает знание в виде взаимосвязей «Причина – следствие».

ЕСЛИ (условие), ТО (описание действия)

Продукционную модель можно использовать в бытовой технике, промышленных и управляемых объектах, в компьютерных играл для формирования интеллекта игры.

Нечеткие системы используются тогда:

1) когда неопределенность наших знаний о рассматриваемом объекте носит сравнительной сравнительный характер и может быть описана с помощью функции принадлежности.

2) Возможно применение для формирование управляющих воздействий (команд) математический строго определенных правил нечеткого вывода.

-

Используется словесная или лингвистическая форма ЕСЛИ (имя_условия), ТО (имя_действия) -

Нечеткие системы созданы для управления объекта в условиях особого вида точности; Данную неточность обычно называются лингвистической неточностью или лингвистической неопределенностью.

Лингвистическая неопределенность складывается из:

- неточности отнесения знания количественной переменной объекта (скорость, путь, время) к одному из понятий (большое, малое…), представляемых в виде слов. Эти слова называют «термы».

Дефаззикация –

Фазикация –

Ошибка дефаззикации проявляющаяся вследствие неточности обратной процедуры перевода значения лингвистической переменной числовое значение непрерывное количество переменных.

Термы --> Лингвистические переменные

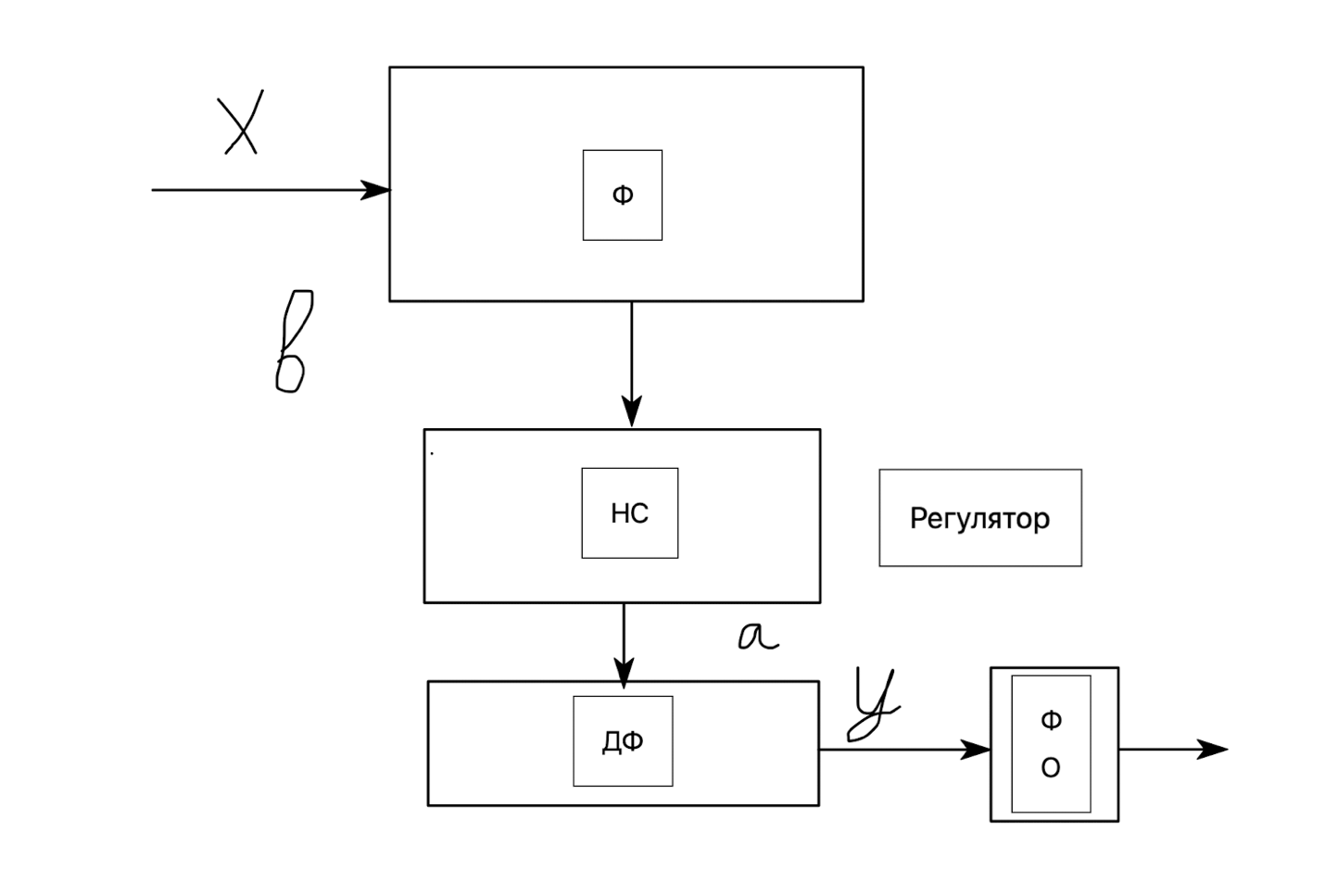

Ф – фазикация

Ф – фазикация

ДФ – дефазикация

Нечеткие множества и лингвистические переменные

Множество А образует такие объекты, для которых указана функция, для которых принимает значение единицы

A = {x(

(x)=1}

(x)=1} x

X, Х – множество всех значений х

X, Х – множество всех значений хТе значения, для которых функция принадлежности равна нулю, не принадлежит множеству А

A={x,

Нечеткое множество, размытое.

Основные свойства нечетких множеств:

А – носитель. А = {x

}

}Если носитель состоит из 1 элемента множества А - x, то такой носитель называется одноточечным

A = x/

Если множества А состоит из конечного числа элементов

, A =

, A =

Если носитель состоит из бесконечного числа множества, то он записывается математически

Если носитель состоит из бесконечного числа множества, то он записывается математическиA

(a, b)

(a, b)Точки перехода к множеству А – это значения, для которых функция принадлежности

03.05

Операции с нечеткими функциями