Файл: азастан республикасы ылым жне жоАРы білім министрлігі.docx

ВУЗ: Не указан

Категория: Не указан

Дисциплина: Не указана

Добавлен: 11.12.2023

Просмотров: 25

Скачиваний: 1

ВНИМАНИЕ! Если данный файл нарушает Ваши авторские права, то обязательно сообщите нам.

ҚАЗАҚСТАН РЕСПУБЛИКАСЫ ҒЫЛЫМ ЖӘНЕ ЖОҒАРҒЫ БІЛІМ МИНИСТРЛІГІ

| Коммерциялық емес акционерлік қоғам «М.ӘУЕЗОВ атындағы Оңтүстік Қазақстан университеті» |

«АҚПАРАТТЫҚ ТЕХНОЛОГИЯЛАР ЖӘНЕ ЭНЕРГЕТИКА» ЖОҒАРЫ МЕКТЕБІ

«ЕСЕПТЕУ ТЕХНИКАСЫ ЖӘНЕ БАҒДАРЛАМАЛЫҚ ҚАМТАМАСЫЗ ЕТУ»

кафедрасы

Зертханалық жұмыс №3

Тақырыбы: Машиналық оқытудағы қателік функциялары

Орындаған: Серікбай Нұрғиса

Тобы: ИП-20-6к1

Қабылдаған: Досанова Гүлжан

Шымкент 2022ж

№ 3 Зертханалық жұмыс. Машиналық оқытудағы қателік функциялары

Жұмыстың мақсаты

Қазіргі машиналық оқытуда қолданылатын қателіктердің негізгі функциялары (жоғалту функциялары) туралы білім мен қолдану критерийлерін алу.

Қысқаша теориялық ақпарат

Шығын функциясы-бағаланатын параметрдің шынайы мәні мен осы параметрдің модельдік бағасы арасындағы алшақтық шамасын бағалайтын функционал.

Регрессия тапсырмалары

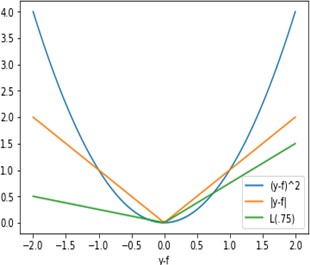

Регрессиялық тапсырмалар үшін жоғалту функциясын таңдағанда, біз шартты үлестірудің қандай қасиетін қалпына келтіргіміз келетінін шешуіміз керек. Ең көп таралған нұсқалар:

????(????, ƒ) = (???? − ƒ)2

-

Gaussian loss (L2), егер қосымша ақпарат немесе модельдің тұрақтылығына қойылатын талаптар болмаса, ең көп қолданылатын және қарапайым нұсқа.

????(????, ƒ) = |???? − ƒ|

- Laplacian loss (L1); кейбір тапсырмаларда бұл шығын функциясы жақсырақ, өйткені ол квадраттық функцияға қарағанда үлкен ауытқуларға айыппұл салмайды.????(????, ƒ) = {(1 − ????)|???? − ƒ| пpи ???? − ƒ ≤ 0

????|???? − ƒ| пpи ???? − ƒ > 0

- Quantile loss (Lq), функция асимметриялы және квантилдің дұрыс жағында орналасқан бақылауларға көбірек айыппұл салады.

Аталған функциялардың графиктері 12-суретте көрсетілген.

Жіктеу міндеттері

Жіктеу кезінде мақсатты айнымалының таралуының түбегейлі басқа сипатына байланысты сынып белгілерінің өзі емес, олардың log оңтайландырылады-сенімділік.

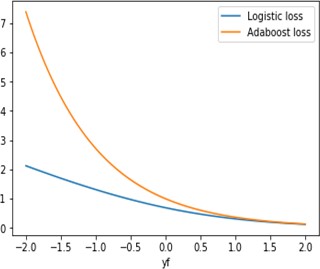

Мұндай шығындардың жіктеу функцияларының ең танымал нұсқалары 13-суретте көрсетілген.

12 – сурет-регрессия есептері үшін жоғалту функциялары

Бұл функцияларды есептеу үшін математикалық өрнектер келесідей:

????(????, ƒ) = ln(1 + exp(−????ƒ))

- Logistic loss (Bernoulli loss). Тіпті дұрыс болжанған сынып белгілеріне айыппұл салынады, бірақ бұл шығын функциясын оңтайландыру арқылы барлық бақылаулар дұрыс болжанса да, жіктеуішті жақсартуға болады. Бұл екілік классификациядағы ең стандартты және жиі қолданылатын шығын функциясы.

????(????, ƒ) = exp (−????ƒ)

-

Adaboost loss; жіктеу қателіктері үшін қатаң экспоненциалды айыппұл бар және сирек қолданылады.

-

Жіктеу есептерінде қолдану үшін кросс-энтропия функциясы да қолданылады, ол екі ықтималдық үлестірімдері арасындағы алшақтық өлшемін анықтайды. Егер кросс-энтропия үлкен болса, екі үлестірімнің айырмашылығы үлкен, ал кросс-энтропия аз болса, үлестірімдер бір-біріне ұқсас:

????(????, ????) = − ∑ ????(????) · log2 ????(????),

13-сурет-Logistic loss және Adaboost loss функциялары

мұндағы P – шынайы жауаптардың таралуы, ал Q-модель болжамдарының ықтималдығының таралуы.

Екілік жіктеу жағдайында кросс-энтропияны есептеу формуласы келесідей болады:

???? = − y · log2 ???? + (1 − ????) · log2(1 − ????),

С мұндағы y – сынып белгісі ағымдағы бақылау үшін дұрыс жіктеу болып табылатындығының екілік көрсеткіші (0 немесе 1), p-жіктеу моделімен анықталған сыныптың болжамды ықтималдығы.