Файл: Контрольная работа по дисциплине Информатика иэиМ .docx

ВУЗ: Не указан

Категория: Не указан

Дисциплина: Не указана

Добавлен: 10.11.2023

Просмотров: 165

Скачиваний: 6

ВНИМАНИЕ! Если данный файл нарушает Ваши авторские права, то обязательно сообщите нам.

Министерство науки и высшего образования Российской Федерации

Федеральное государственное бюджетное образовательное учреждение

высшего образования

Владимирский государственный университет

им. А.Г. и Н.Г. Столетовых

Кафедра "экономическая безопасность"

Контрольная работа по дисциплине

Информатика [ ИЭиМ ]

| | | | |

| | | | |

| | | Выполнил: | студент группы ЗЭБд-122 |

| | | | группа |

| | | | Мишкин |

| | | | Фамилия |

| | | | Кирилл Александрович |

| | | | Имя Отчество |

| | | | |

| | | | |

| | | | |

| | | | |

| | | | |

Владимир 2023

Лекция 1. Понятие информации. Информационные

процессы.

Ответы на вопросы:

Вопрос 1: Как вы понимаете термин «информация»? Что общего и каковы различия между бытовым понятием этого термина и его научными трактовками?

Ответ: В широком смысле информация – это отражение реального мира, в узком смысле – это любые сведения, являющиеся объектом хранения, передачи и преобразования. Понятие «информация» вместе с понятиями «вещество» и «энергия» относятся к основным понятиям науки, поэтому строгого и точного научного определения этому понятию дать невозможно.

В обиходе информацией называют любые данные или сведения, которые кого-либо интересуют. В «Энциклопедии кибернетики» информация определяется как «одно из наиболее общих понятий науки, обозначающее некоторые сведения, совокупность каких-либо данных, знаний и т.п.».

Вопрос 2: Зависит ли информативность сообщения от того, кто и как фиксирует неопределенность соответствующей информации?

Ответ: Согласно Шеннону, информативность сообщения характеризуется содержащейся в нем полезной информацией, т.е. той частью сообщения, которая снимает полностью или уменьшает существовавшую до ее получения неопределенность какой либо ситуации. Величина неопределенности некоторого события – это количество возможных результатов (исходов) данного события. Такой подход к определению информации называют содержательным. Так, например, неопределенность погоды на завтра обычно заключается в диапазоне температуры воздуха и возможности выпадения осадков. Причем в разное время года диапазон возможных исходов данного события различен и колеблется в районе 16 ожидаемых результатов для значения дневной температуры и трех-четырех – для осадков (без осадков, кратковременные дожди ливневые дожди с градом и т.п.).

Вопрос 3: При игре в кости используются два игральных кубика, грани которых помечены цифрами от одного до шести. В чем заключается неопределенность знания о бросании одного кубика? А двух кубиков одновременно?

Ответ: Если число возможных исходов события не зависит от суждений различных людей, то получаемая информация о наступлении одного из возможных исходов является объективной. Примером такой информации является сообщение о результате падения подброшенного игрального кубика или двух кубиков.

Вопрос 4: Сколько гигабайт содержится в 216 килобайтах? Сколько мегабайт содержится в 230 килобайтах?

Отверт: 216 килобайт = 65 536 килобайт = 0.0625 гигабайта

230 килобайт = 1 073 741 824 килобайт = 1 048 576 мегабайта

Вопрос 5: Приведите примеры жизненных ситуаций, при которых мы получаем ровно 1 бит информации.

Вернулся ли человек домой после работы? «Вернулся» - это сообщение содержит один бит информации.

Вопрос 6: Для того, чтобы путешествовать по населенным пунктам Владимирской области, автомобилист приобрел книгу автомобильных дорог 1980 года издания. Будут ли сведения, полученные из этой книги информативными? Почему?

Ответ: Сведения, полученные из этой книги информативными не будут потому что, по всем 5 свойствам информации, карты будут не объективными, не достоверными, не полными, не актуальными и не адекватными.

Вопрос 7: Приведите примеры информации, отвечающей всем необходимым свойствам информации.

Ответ: Монета упала решкой.

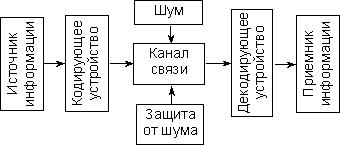

Вопрос 8: Изобразите схему процесса передачи информации.

Ответ:

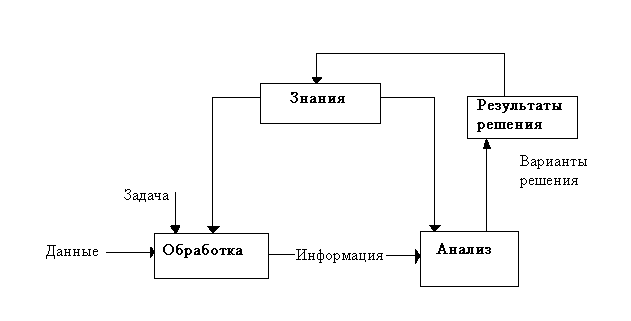

Вопрос 9: Представьте в виде схемы взаимосвязь данных, информации и знаний в процессе принятия решений.

Ответ:

Вопрос 10: Как вы понимаете термин «информационная культура»? Какими ключевыми словами вы определили бы это понятие?

Ответ: Информационно культурный человек, это человек, умеющий получать, обрабатывать и использовать в необходимых целях информацию, по средством современных инструментов–технологий.

Ключевые слова: умение получать, обрабатывать и использовать информацию.

Вопрос 11: Заполните таблицу

Ответ:

| Информационная революция | С чем связана | Какие возможности появились |

| Первая информационная революция | изобретение письменности | распространения знаний и сохранения их для передачи последующим поколениям |

| Вторая информационная революция (середина XVI века) | изобретение книгопечатания | паспространение и хранение большого кол-ва информации. |

| Третья информационная революция (конец XIX века) | изобретение электричества | появились телеграф, телефон, радио, позволяющие оперативно передавать информацию |

| Четвертая информационная революция (70-е годы XX века) | изобретение персонального компьютера | активное внедрение компьютерной техники и новых информационных технологий в различные сферы производства, общественной и личной жизни людей |

Вопрос 12: Выразите свое отношение к информационному кризису, заполнив таблицу.

Ответ:

| + | - | ! |

| Доступность информации | Информационный шум – нужно фильтровать информацию | Как фильтровать информацию из всех источников |

Модуль 1. Измерение информации. Количество информации.

Тема 2.1 Определение количества информации. Формула Хартли.

Задания:

Задача 1: В корзине лежат 16 шаров. Все шары разного цвета и среди них есть красный. Сколько информации несет сообщение о том, что из корзины достали красный шар?

Решение: Поскольку все шары разного цвета, то вытаскивание одного шара из 16 ти равновероятно. Количество информации определяется по формуле: 2^I=N, где I – количество информации, а N=16 – количество шаров. Тогда 2^I=16, отсюда I=4 бита.

Задача 2: В корзине лежат 8 черных и 8 белых шаров. Сколько информации несет сообщение о том, что из корзины достали белый шар?

Решение: Найдем вероятность того, что достанут белый шар:

P(Б) = 8/16 = 1/2.

Далее воспользуемся формулой Шеннона:

1/p = 2i. Здесь i и есть количество информации, которое мы ищем. Выведем его отсюда:

i = log2(1/p) = log2(2) = 1. - 1 бит информации принесет сообщение о том, что белый шар достали из корзины.

Задача 3: В корзине лежат 16 шаров. Среди них 4 белых, 4 черных, 4 красных и 4 зеленых. Сколько информации несет сообщение о том, что из корзины достали красный шар?

Решение: Сначала считаем вероятность вытаскивания красного шара она равна 1/4. Количество информации 2^i = обратной величине вероятности. Т.е.2^i=4, т.е.i=2 бит

Задача 4: При угадывании целого числа в диапазоне от 1 до N было получено 7 бит информации. Чему равно N?

Решение: Поскольку выбор числа равновероятен из заданного диапазона, то количество информации определяется по формуле 2I=N, где I=7 бит, а N – количество чисел в искомом интервале. Отсюда 27=N, N=128

Ответ: N=128

Задача 5: Какое количество информации содержит один символ алфавита, состоящего из 1024 символов?

Решение: N = 2i

1024 = 210 => i = 10

Задача 6: Сколько бит несет слово «ИНФОРМАЦИЯ»?

Решение: Каждая буква весит 1 байт или 8 бит. Значит слово «ИНФОРМАЦИЯ» несёт в себе 80 бит, поскольку состоит из 10 букв.

Задача 7: В алфавите некоторого языка две буквы «А» и «Б». Все слова на этом языке состоят из 11 букв. Каков словарный запас этого языка, т.е. сколько слов он содержит?

Решение: A = Ni

N = 2 (А,Б — две буквы) i = 11 A = 211 = 2048 слов в словарном запасе этого языка.

Задача 8: Информационное сообщение объемом 1,5 килобайта содержит 3072 символа. Сколько символов содержит алфавит, при помощи которого было записано это сообщение?

Решение: I = 1,5 Кб, К = 3072 символа. N — ? I= 1,5 Кб = 1,5 • 1024 • 8 = 12 288 бит. I = I/K = 12288/3072 = 4 бита N=2i = 24 =16 символов содержит алфавит, при помощи которого было записано это сообщение.

Задача 9: Алфавит первого племени содержит N символов, алфавит второго – в два раза больше. Племена обменялись приветствиями, каждое по 100 символов. Приветствие какого племени содержит больше информации (в битах) и на сколько?

Решение: На кодирование символов алфавита первого племени понадобится 100 * Log(N)/Log(2) бит информации На кодирование символов алфавита второго племени понадобится 100 * Log(2N)/Log(2) = 100 + 100 * Log(N)/Log(2) бит информации А разность между этими величинами — ровно 100 бит

Задача 10: В процессе преобразования растрового графического файла количество всех возможных цветов было уменьшено с 1024 до 32. Как и во сколько раз изменился размер файла?

Решение: Информационный объем графического файла (то есть объем памяти, который он занимает) определяется, как произведение числа пикселей в изображении на количество бит/байт, которые отводятся для хранения информации о цвете данного пикселя.

Для хранения информации о 1024 цветах необходимо 10 бит (210 = 1024), а для хранения информации о 32 цветах требуется всего 5 бит. То есть при уменьшении количества цветов с 1024 до 32, количество бит, отведенных для хранения цвета каждого пикселя, будет занимать в 10: 5 = 2 раза меньше места. Следовательно, информационный объем файла также уменьшится в 2 раза.

Модуль 2. Измерение информации. Количество информации.

Тема 2.2 Формула Шеннона.

Задача 1: В ящике лежат 36 красных и несколько зеленых яблок. Сообщение «Из ящика достали зеленое яблоко» несет 2 бита информации. Сколько яблок в ящике?

Решение: По фоpмуле Хаpтли количество информации в битах = -log_2 p, где p - вероятность события. Стало быть, в данном случае вероятность вытащить зеленое яблоко ровна 1/4. То есть 1/4 всех яблок - зеленые (а оставшиеся 3/4 - красные). Следовательно, всего яблок - 48.